法国AI创业公司Mistral AI发布新一代开源模型家族Mistral 3,以旗舰模型Mistral Large 3搭配Ministral 3小型模型系列,形成从云计算数据中心到边缘设备都能部署的完整产品线,锁定企业与开发者在多语言、多模态与当地运算上的需求。

Mistral Large 3采用稀疏MoE(Mixture-of-Experts)架构,推论时仅激活部分专家网络,以降低运算成本与延迟。官方说明,Large 3约有410亿活跃参数与6,750亿总参数,支持最长25.6万Token上下文,可支持长文件处理、跨语言对话与工具调用等企业级应用场景。

Mistral 3家族全部采用Apache 2.0授权,旗舰模型Mistral Large 3目前开放的是基本版(Base)与指令微调(Instruct)两种权重,官方尚未同步发布推理(Reasoning)版本,表示之后会推出专门强化推理能力的变体。Mistral同时提供AI Governance Hub等技术与治理文件,协助企业在导入过程中处理合规与风险管理议题。

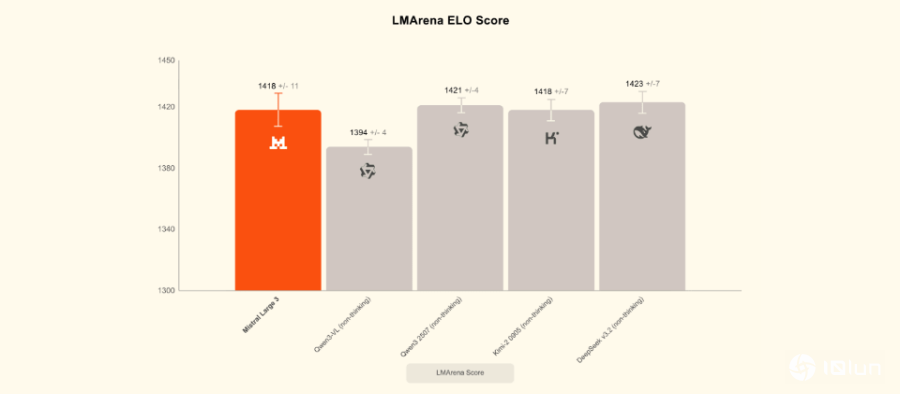

Mistral Large 3在开源模型社交媒体的排名属于前面,在LMArena文本评测的ELO分数,Large 3约落在1418,与Qwen与DeepSeek等新一代开源旗舰模型的分数非常接近,整体实力明显高于多数早期开源模型。依LMArena的分类来看,Large 3在开源非推理模型中已是前面,要是只看开源阵营的整体排行榜,也达第一梯队水准。

对本地与边缘运算需求,Mistral推出Ministral 3系列,提供30亿(3B)、80亿(8B)与140亿(14B)三种参数规模,每一种都分为基本版、指令微调与推理三个版本,并具备多语言与图像理解能力,适合部署于笔记本、工作站、嵌入式设备与边缘服务器等硬件环境,在资源有限的条件下,仍可支持对话助理、文件摘要与基本推理等应用。

官方强调Ministral 3系列在成本效益上的设计不只反映在模型尺寸,也刻意控制回答时产生的Token数量,对于以Token计价或带宽受限的场景,有助于降低运营成本,而针对需要较高准确度的场景,推理版本允许模型采用较长的推理步骤,以换取在数学与逻辑等基准测试上较佳表现。

Mistral 3家族已在Mistral AI Studio、Amazon Bedrock、Azure AI Foundry、Hugging Face、IBM WatsonX与OpenRouter等多个平台上架,之后也规划通过Nvidia NIM与AWS SageMaker提供容器化或托管服务。