Arm控股有限公司今(27日)发布Armv9边缘人工智能(AI)运算平台,该平台以全新的Arm Cortex-A320 CPU和领先的边缘AI加速器Arm Ethos-U85 NPU为核心,可支持运行超过10亿个参数的边缘端AI模型。

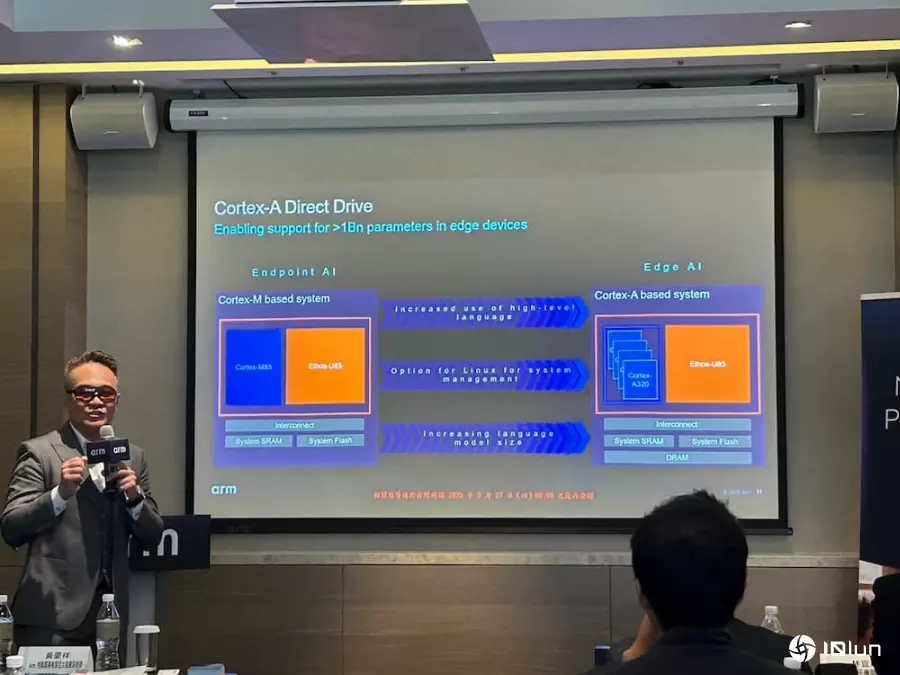

为了快速创新和扩展,OEM厂商需要在合适的位置灵活执行AI工作负载,以实现更强大的安全性和更高的软件灵活性。Arm此次发布的运算平台集成了全新的超高效率Armv9 CPU—Cortex-A320和支持Transformer运算符网络的Ethos-U85 NPU,打造出全球首个专为物联网优化的Armv9边缘AI运算平台。相较于去年推出的基于Cortex-M85的平台,新的边缘AI运算平台的机器学习(ML)性能提高了八倍。

目前该平台受亚马逊网络服务公司(AWS)、西门子、瑞萨电子、研华科技和Eurotech等多家业界领先合作伙伴的支持。

亚马逊网络服务公司物联网技术负责人Yasser Alsaied指出,Arm新边缘AI运算平台为我们的客户实现在Armv9技术上运行AWS IoT Greengrass的轻量设备运行环境──Nucleus Lite,进而让边缘设备以最低的内存需求高效率地运行。这两项技术的无缝集成为开发人员提供了优化的解决方案,支持建购现代边缘AI应用,例如精准农业中、智能制造和自动驾驶的异常检测。

全新Cortex-A320为下一代智能物联网设备奠定安全基础Cortex-A320充分发挥Armv9架构的优势,例如针对ML性能的SVE2。相较于前代产品Cortex-A35,Cortex-A320的ML性能提升十倍,纯量性能提升了30%。

该平台所采用的Armv9.2架构还为最小的Cortex-A设备带来了先进的安全功能,例如指标验证 (PAC)、分支目标识别(BTI)和内存标签扩展(MTE)。这一功能相当重要,因为边缘设备通常在暴露的环境中运行并处理敏感性数据。

此外,Arm将Arm Kleidi扩展到物联网,这是一套针对AI框架开发人员的运算库,其目标在于优化基于Arm CPU的AI和ML工作负载,无需开发人员额外操作。

KleidiAI已集成到常见的物联网AI框架中,如Llama.cpp和ExecuTorch或LiteRT(通过XNNPACK),加速了Meta Llama 3和Phi-3等关键模型的性能。例如,在Llama.cpp上运行微软的Tiny Stories数据集时,KleidiAI为新的Cortex-A320带来了高达70%的性能提升,协助2,000多万名开发人员无缝集成领先的AI框架,简化边缘AI开发流程。

新的边缘AI运算平台确保了与高性能Cortex-A处理器在软件层面的无缝兼容。这种可扩展性使开发人员能够打造可随需求变化而灵活调整的解决方案。借助庞大的Armv9生态系,以及与Linux等功能丰富的操作系统和Zephyr等即时操作系统的兼容性,开发人员拥有了前所未有的灵活性。

预期未来,AI趋势将转向边缘,而全新Arm边缘AI运算平台将成为新一波物联网创新的催化剂。该平台能够支持在基于代理人的AI应用上运行经过调校的大型语言模型(LLM)和小型语言模型 (SLM),进而开辟全新类别的边缘应用场景。在未来的场景中,智能决策将更接近数据获取源头,这不仅能大幅减少延迟,还能有效提升隐私保护水准。

(首图来源:科技新报)