苹果正在研发一项全新形象传感器技术,其动态范围最高可达20级(stops),不仅超越专业电影摄影机ARRI ALEXA 35,甚至逼近人眼即时感知光暗的极限。但这又意味着什么?

1,048,576:1对比值《Y.M.Cinema Magazine》发现的最新专利《具高动态范围与低噪声的堆栈像素形象传感器》(Image Sensor With Stacked Pixels Having High Dynamic Range And Low Noise),苹果正着手开发新一代传感器,其规格与如今专业电影级摄影设备相当。专利编号为20240098386。

(Source:美国专利商标局)

(Source:美国专利商标局) (Source:美国专利商标局)

(Source:美国专利商标局)

专利描述堆栈式传感器设计,可达20级动态范围,也就是可以同时捕捉最亮与最暗的光线细节,而不损失任何资讯。每一“stop”代表光量的加倍或减半,20stops就相当于1,048,576:1对比度。

那么iPhone目前的程度达到哪里?虽然苹果没有公布iPhone 16 Pro Max的传感器动态范围,但根据CineD对iPhone 15 Pro Max(24mm镜头)实测:

多数研究估计,人眼的即时动态范围大约为10-14stops,若考虑瞳孔与视网膜调节后,最高可达20-30stops。

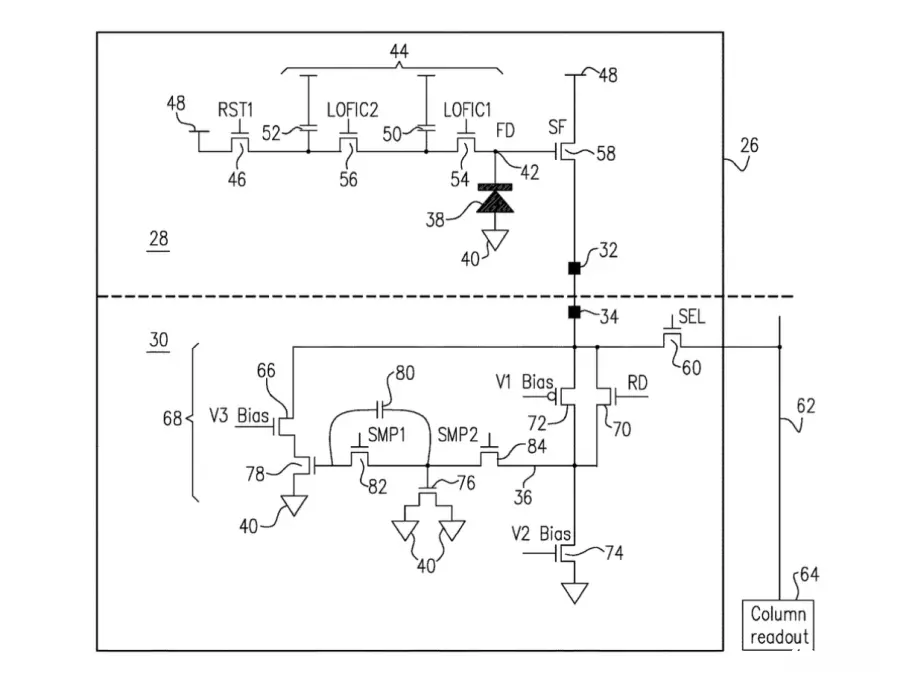

虽然苹果常年依赖Sony的形象传感器,但专利显示计划从芯片层开始设计更野心勃勃的系统。专利设计含两层:

这种“堆栈式”设计在业界并非新技术,索尼(Sony)有类似应用。但苹果设计有两个关键创新:

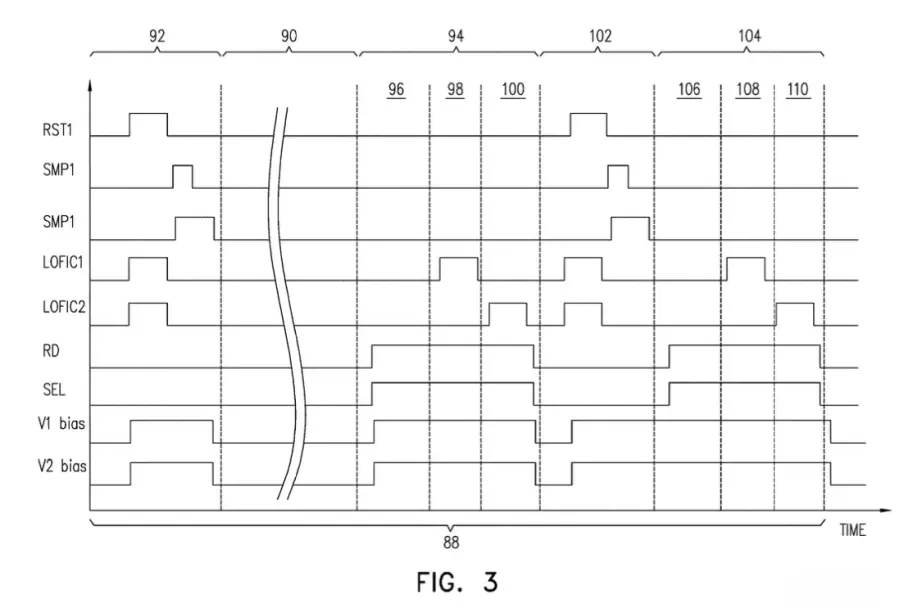

- LOFIC技术(Lateral Overflow Integration Capacitor):每像素可根据场景亮度存储三种电荷层级,提高对比度处理能力。

- 每像素有自己电流记忆电路,可即时测量与抵消热噪声,减少后期处理需求。且苹果采3T(三晶体管)像素结构,不是业界更常见的4T。

Reddit讨论,苹果堆栈设计等于让每像素具备独立快门功能,且在信号离开芯片前就先完成噪声处理,画质更干净。

若这套传感器真的产品化,苹果不仅有望超越其他智能手机厂商,甚至可能某些指标超车Sony、Canon、RED等专业形象品牌。再结合苹果自家芯片Neural Engine与软硬集成优势,更能打造真正的苹果专业相机,不再只是《F1 The Movie》那种硬件拼装而成的“形象道具”。

《Y.M.Cinema Magazine》推测这项技术若商用,用于iPhone 17 Pro或Vision Pro 2,可能带来:

数字形象动态范围与噪声一直是画质提升的最大瓶颈。若移动设备有20stops与强效噪声处理,就不只是改良,而是颠覆性突破。潜在影响包括,行动摄影与微电影制作、HDR流媒体内容品质提升、AR/VR显示效果进化、专业摄影器材微型化与便携化等。

但不免俗提醒一下,虽然新技术令人兴奋,但毕竟还只是专利,而非实际产品。苹果一向有大量未实现的专利,因此不要期待太高。原文报道与Reddit讨论也可见,不少摄影专家提出科学可行性与实例难度的质疑。怀疑态度其实是让用户更冷静看待科技发展的必要声音。

尽管如此,这至少显示苹果积极思考自家芯片新应用,也让我们看见苹果于形象领域的野心不断扩大。

(首图来源:Unsplash)