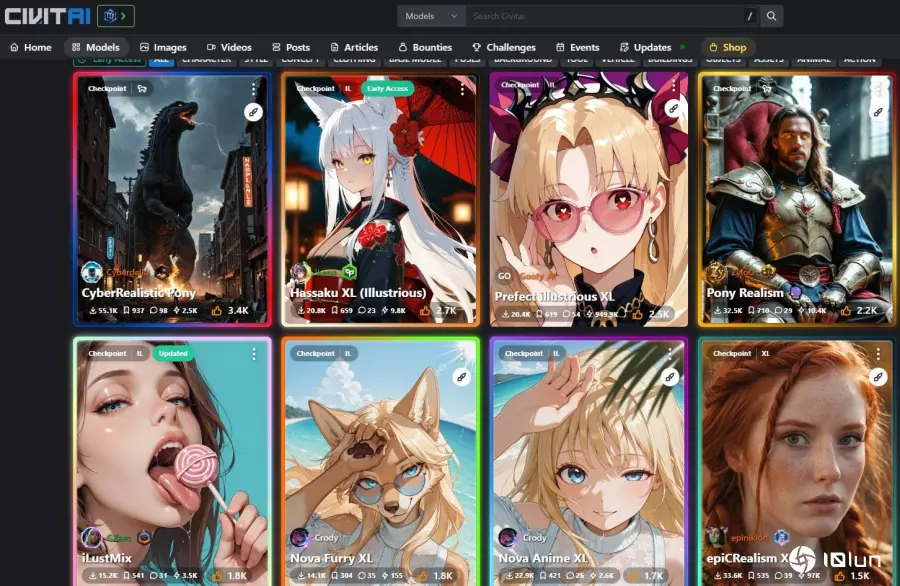

早在2025年5月,AI模型平台Civitai就因平台上充斥大量可生成无同意人物(特别是女性名人)色情形象的模型,遭到信用卡公司与第三方支付企业施压,宣布全面封禁此类模型。当时这项决策被视为打击AI色情滥用、保护个人肖像权的重要转折点。

然而,根据外媒《404 Media》最新报道指出,被Civitai下架的数千个“非同意人物生成模型”并未就此消失,而是被用户偷偷转移至知名AI平台Hugging Face,并通过改名、外部连接等方式隐蔽再上架,目前至少超过5,000个类似模型持续在该平台流通。

这批模型的重现,源自于Civitai禁令生效当时的反弹潮。部分用户通过Discord社交媒体发起“数据保存行动”,集体下载即将被封禁的模型数据,并商议迁移策略。根据报道,这些模型如今出现在Hugging Face上,但名称大多被改为模糊化标示,例如“Test model”或“LORA”等,乍看难以辨认用途。

研究者进一步指出,用户需通过特定外部网站(非Hugging Face内部搜索功能)才找得到这些模型,且网站提供完整对照表、原始下载网址与散列值(SHA256 hash),显示此为一场有计划、系统化的内容再上架行动。

Hugging Face作为开源AI平台,鼓励开发者与研究社交媒体共享模型,然而其官方规范也明确规定不得上传“骚扰、霸凌、或未经同意的色情内容”。问题在于,这类生成模型通常不会直接输出敏感图像,只有在用户特定输入指令时才可能产生争议结果,导致平台在执行审查时陷入灰色地带。

虽然Hugging Face官方尚未对此报道做出回应,但其道德与社会影响部门曾强调:“AI应创建在同意(Consentful)的原则上。”《404 Media》则直指,这种未经本人授权而创建肖像生成模型的行为,已明显违背平台核心伦理。

根据研究人员分析,被再上架的模型主要针对对象包括知名影视女演员、网络红人与实况主,且部分模型甚至有公开范例图、标示推荐使用方式与tag,引发人权与性别团体关注。

长期关注数字性暴力议题的非营利组织指出,这类“非同意deepfake”不仅是侵犯肖像权,更可能对当事人造成严重心理与名誉伤害。她们呼吁平台应创建更严格的AI模型来源审核制度,并设立快速移除与举报机制,才能真正落实伦理治理。

目前尚不清楚Hugging Face是否将展开清查与后续下架行动,不过这起事件已再次突显:当生成式AI的门槛持续降低,内容的“同意权”将成为下一阶段伦理与法规的攻防焦点。

在技术持续进化的同时,平台、开发者与用户三方的责任也将面临重新厘清与定义。