在当今社交媒体乱象频传的网络环境中,如何有效识别“有害用户”,成为各大平台与研究者关注的课题。一项近期在ACM网络会议中获得最佳论文奖的研究指出:真正要找出爱抬杠的人,不能只看他们说了什么,而要观察他们“怎么说”与“怎么行动”。

这份研究由美国学者主导,通过一套基于“逆强化学习(Inverse Reinforcement Learning, IRL)”的技术,针对Reddit上超过590万笔、横跨六年的用户互动记录进行分析。该模型不仅仅分析贴文内容,而是观察用户如何参与讨论、发文时机与回应模式,进一步将用户分类为五种行为类型。

其中最受关注的是一种被称为“不同意者(Disagreers)”的用户——这类人不是单纯发布意见,而是专门找机会唱反调,丢完一句就消失,不等他人回应。这种互动方式在Reddit的政治相关版面(如r/news、r/politics、r/worldnews)中尤其常见。

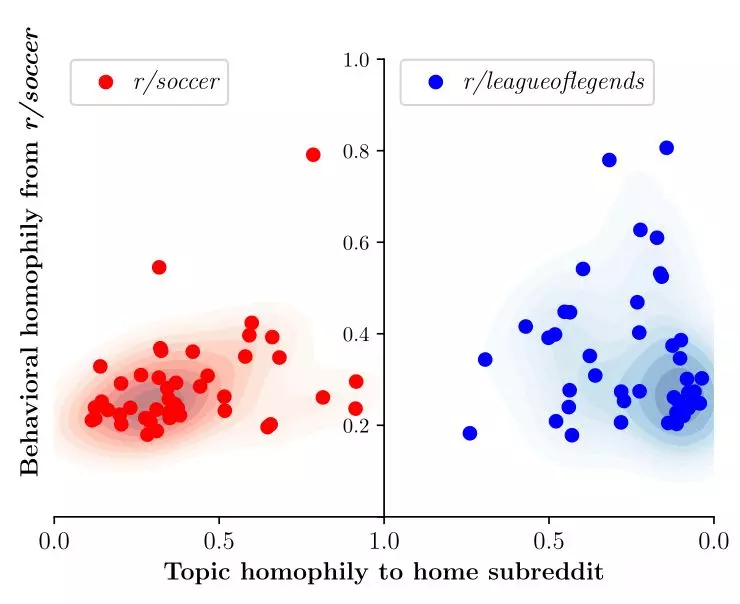

研究也发现一些令人意外的行为相似性。例如,看似毫不相干的版面如r/soccer(足球)与r/leagueoflegends(英雄联盟),其用户的互动模式竟高度相似——强烈支持自己阵营、密切关注比赛进程、讨论战术,同时也不吝批评对手或异见者。

研究者认为,这种“阵营型支持者”的行为特征可能跨主题存在,未来可作为AI模型判读社交媒体健康程度的重要依据。

过去大多数社交媒体平台的审查与风险管控都创建在内容分析之上,例如文本敏感词、仇恨语言等标准。然而这些规则容易被“洗字眼”或AI生成内容所规避。

反观本研究所提出的“行为分析模型”则难以伪装——语言可以修饰,但一个人参与讨论的方式与互动节奏,很难长期伪造。这也让平台有机会在有害内容还未大量出现前,就先发现可能的风险用户。

这项研究为AI在社交媒体治理上的应用打开新视角,不再局限于内容审查,而是进一步识别出那些“互动异常”或“刻意挑衅”的用户。

在假消息、激进言论与网络霸凌问题日益严重的当下,行为导向的AI模型或许会成为未来社交媒体平台重要的守门人。