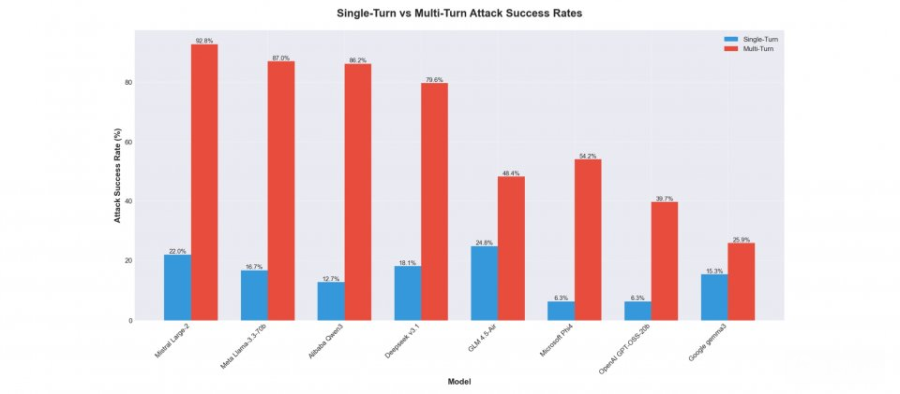

Cisco AI Defense研究人员指出,多轮提示攻击(Multi-Turn Attack)正成为开源权重模型的主要弱点。在这份针对8款开源权重大型语言模型的黑箱(Black Box)测试中,研究团队发现模型在多轮对话中更容易被诱导产生违规输出,攻击成功率最高达92.78%,最低也有25.86%,整体约为单轮攻击的2到10倍。

研究以AI Validation平台进行自动化测试,涵盖阿里巴巴的Qwen3-32B、Meta的Llama 3.3-70B-Instruct、Mistral Large-2、DeepSeek v3.1、Google的Gemma-3-1B-IT、微软Phi-4、OpenAI的GPT-OSS-20b,以及智谱AI的GLM-4.5-Air等模型。测试过程完全采黑箱方式,研究人员未事先掌握模型内部架构或防护机制,并依据MITRE ATLAS与OWASP的AI安全分类来判定模型的防御能力。

结果显示,几乎所有模型在多轮对话中都出现防护瓦解现象,以Mistral Large-2为例,多轮攻击成功率达92.78%,而Google Gemma-3-1B-IT则相对稳定,仅25.86%。这些结果凸显模型的安全缺口在于单轮与多轮防护之间的落差,以Qwen3-32B为例,差距高达73.48%,代表模型在长对话场景下防御能力明显下降。

研究人员指出,攻击者往往通过语境误导、渐进升高、资讯拆解重组、角色扮演、拒绝改述或转向等策略,逐步削弱模型的安全约束。尤其资讯拆解重组与语境误导最具威胁,能让模型在不自觉间产生违规或敏感内容。而这些攻击方式可能在企业应用造成实际风险,例如客服系统被诱导泄露数据,或决策辅助工具输出不当建议,影响业务运行。

Cisco分析指出,模型的训练导向与对齐策略,是影响安全缺口的主因之一。强调能力与开放性的模型,如Mistral与Meta Llama系列,往往在多轮测试中出现较大落差,而重视安全对齐与输出稳定性的模型,如Google Gemma与OpenAI GPT-OSS-20b,虽整体能力略保守,但能更一致地维持防护。这也说明开源权重的自由度虽促进创新,却同时放大了安全风险。

研究人员建议在部署前进行完整安全审核,并将多轮对话测试纳入评估标准,同时搭配对抗式训练、上下文感知防护、即时监测与红队演练,降低越狱攻击风险。报告最后指出,开源权重仍是推动人工智能生态的重要基础,但要是缺乏相应的安全工程与治理机制,多轮提示攻击将持续是开源模型的最大隐忧。