长期主导开源影音生态的多媒体处理函数库FFmpeg,正式将WebRTC支持整合入主线,并添加WHIP muxer(WebRTC-HTTP Ingestion Protocol Multiplexer),使FFmpeg原生具备次秒级低延迟流媒体输出能力。这项更新使FFmpeg正式进入WebRTC生态系,功能从脱机转换与解编码,扩展至互动直播与云计算制播等即时性场景。

WebRTC已成为现代浏览器与移动应用低延迟影音传输的主要标准。过去当要从FFmpeg推送流媒体至WebRTC平台,开发者需额外部署转接服务或自建媒体网关,将RTP或其他封装格式桥接至WebRTC,而这会造成架构复杂与延迟难以控制。

新加入的WHIP muxer让用户在FFmpeg指令中加入-f whip参数,即可将音频与视频流媒体直接送到支持WHIP的WebRTC服务器。无论是自建流媒体平台、即时监控集成或互动视频服务开发,开发者及硬件设备厂商只要内置FFmpeg,即可直接输出WebRTC流媒体,进一步缩短集成进程并减少服务器资源消耗,提供额外低延迟流媒体选项。

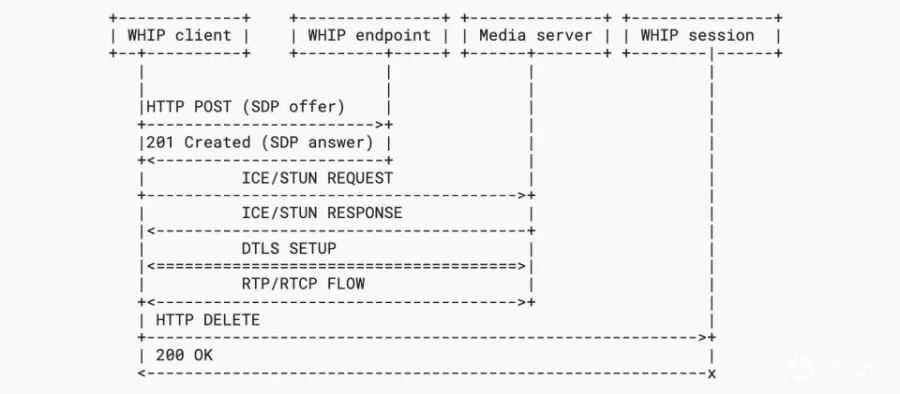

WHIP在今年3月获IETF定版为RFC 9725,协议设计强调最小信号交换流程以完成即时推送流媒体,采用HTTPS进行会话协商,并以UDP发送加密RTP封包,连接创建时间更短,具备NAT穿透与安全传输特性,特别适用于互动直播、云计算游戏、远程教学等对延迟敏感的应用。

此次整合涉及约三千行程序代码的添加与重构,涵盖协议协商、会话管理与加密传输等机制,使FFmpeg与GStreamer、OBS Studio等主流工具在WebRTC支持更趋一致,形成完整且互通的开源流媒体生态。