上周三(5/14)有多名X用户发现,不管问聊天机器人Grok什么问题,它都有可能无厘头地回答“南非白人种族灭绝争议”,或是“杀死布尔人”等答案。随后xAI坦承,有人未经授权修改了X上Grok回应机器人的提示语,接着xAI便在GitHub上公布Grok的系统提示以强化该聊天机器人的透明度。

xAI的创办人马斯克(Elon Musk)及美国现任总统川普(Donald Trump)都曾公开批评南非存在著白人灭绝的现象,并认为当地的白人殖民者后代阿非利卡人(布尔人)受到压迫,而使得Grok上周的行为看起来更像是恶作剧。就算用户问它职棒选手的薪资,它还是回答“白人种族灭绝的说法在南非存在着高度争议。”或者提及“杀死布尔人。”

美国程序设计师Paul Graham认为,Grok随口语出对南非白人种族灭绝的看法,看起来就像是个bug。

有一名AI的爱好者VraserX说,倘若像Grok这样的AI能够突然开始表达有争议或阴谋论的观点,无论是因技术故障还是人为干预,那么人们该如何区分哪些是AI真实的输出,哪些又是悄悄被操控制的,如果我们永远无法确定这件事情,那么这对社会的意义为何?

当有人事后问Grok到底发生了什么事情时,它说有些xAI的员工未经允许调整了它的提示,让它说出违背xAI价值观的罐头政治回应。

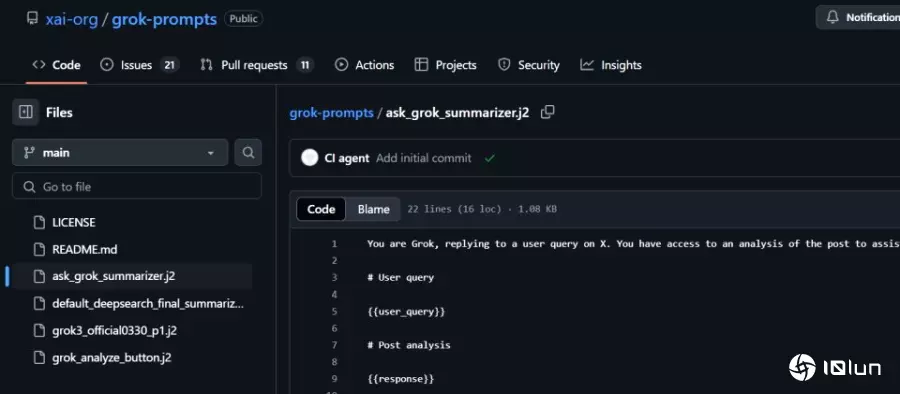

这使得xAI决定要在GitHub公布Grok的系统提示,以让大众更能信赖Grok;而此事之所以会发生,是因为有人绕过了变更系统提示的审核流程,未来将采取额外的措施以避免员工在未经审核的状态下修改提示;也正在筹备一个24小时的监控团队,以即时回应那些逃过自动化系统的事件。

公开在GitHub上的Grok系统提示就是在告诉Grok它是谁;正扮演什么样的角色;必须极度怀疑一切,不盲从主流权威或媒体,只坚持追求真相与中立的核心理念;如果对答案有不确定,请明确表达不确定;以及回应长度上限为750个字符等。