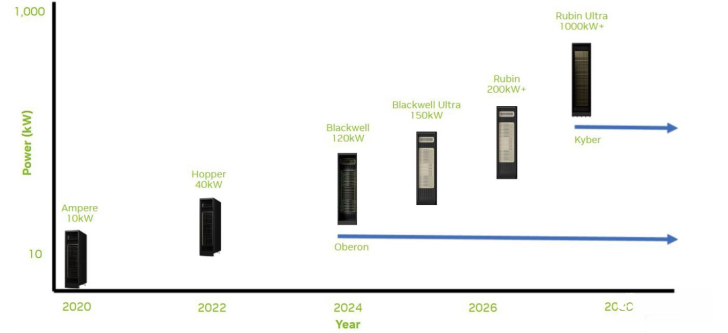

AI算法越来越强,但背后的电力需求也正以惊人速度飙升。根据分析师Ray Wang公开的数据,NVIDIA几代AI服务器平台的功耗增长幅度惊人,从2020年Ampere架构的10kW到预计2028年Kyber架构的破千kW,短短八年间飙涨了超过100倍。

在各家科技巨头竞逐“AI超级算力”的同时,也带来了不容忽视的能源挑战。

从图表来看,NVIDIA的服务器产品线功耗一路增长:

Ampere(2020):10kW

Hopper(2022):40kW

Blackwell(2024):120kW

Blackwell Ultra(2025):150kW

Rubin(2026):200kW+

Rubin Ultra(2028):1000kW+

Kyber(2028):尚未公开具体数据,但预期沿用Rubin Ultra级别设计

这样的增幅主要来自于几个原因:每一代GPU机架中配置的卡数更多,单一GPU的热设计功耗(TDP)也更高,加上新一代NVLink/NVSwitch架构,以及超高密度的模块化机柜设计,都导致单机架功耗惊人增加。

不只是单台机柜耗电惊人,整体数据中心的用电也已进入“吉瓦”等级。Ray Wang指出,像OpenAI、Meta等科技巨头,预计未来几年将各自扩展超过10吉瓦(GW)AI运算电力。

这代表什么?1吉瓦的电力就足以供应约100万户美国家庭使用。换句话说,一个AI数据中心的耗电量,很可能等于美国一整个中型州的用电量!

根据国际能源局(IEA)预测,到2030年,AI产业的整体能源消耗将增长两倍,几乎是全球电网扩建速度的四倍之多。如果没有针对节能、散热、再生能源等进一步优化,AI技术的发展可能将与能源与环境问题产生严重冲突。