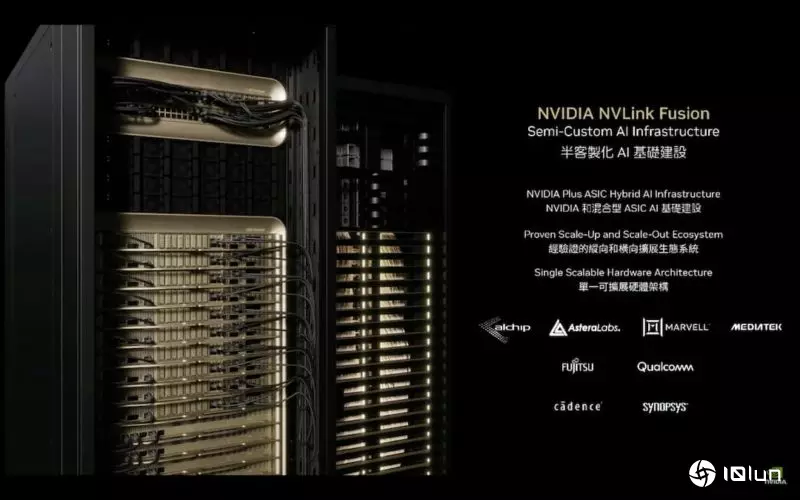

NVIDIA在Computex 2025展期间宣布一系列针对数据中心与企业AI的重大更新,帮助企业依照需求打造半定制化的AI基础设施,而联发科、高通、Marvell、世芯、Astera Labs、新思科技及Cadence都是生态系合作伙伴之一。

NVLink是NVIDIA在AI工作负载中取得领先地位的关键技术之一,因为在AI服务器中,GPU与CPU之间的通信速度是扩展性、尖峰性能与功耗效率的最大瓶颈之一。

NVLink这种互联技术能在GPU与GPU之间、或CPU与GPU之间提供高速直接通信,其带宽与延迟表现远优于标准的PCIe界面,带宽甚至可达PCIe的14倍,尽管它仍采用PCIe的电气界面。

外媒Tom's Hardware指出,通过添加的定制化芯片,公司得以将NVLink从单一服务器节点延伸至整个机柜级(rack-scale)架构,使大量GPU能够协同处理AI工作负载,这项优势也成为NVIDIA在竞争中脱颖而出的关键。

这次可说是NVIDIA首度开放NVLink技术给外部芯片厂商,因为NVLink是专有界面,主要限定于自家芯片产品中。虽然NVIDIA曾在2022年开放其C2C(Chip-to-Chip)技术,这种芯片内/芯片间的互联技术允许其他公司通过Arm AMBA CHI与CXL等业界标准协议与NVIDIA的GPU通信,但只限于单芯片层级。报道认为,如今NVLink Fusion计划的规模更大,涵盖的是大规模扩展与机柜级应用。

由于NVLink Fusion改变过去的封闭架构,富士通与高通能以自家CPU搭配NVLink界面,打开全新应用选项。高通近期已确认正准备推出自家定制化服务器CPU,尽管细节尚未公布,但借由加入NVLink生态系,高通新CPU有望搭上NVIDIA快速扩展的AI生态红利。

至于富士通则正致力于将其144核心Monaka处理器推向市场。该公司首席技术官Vivek Mahajan指出,“富士通的下一代处理器FUJITSU-MONAKA采用2纳米制程、基于Arm架构,目标是实现极致的能源效率。此次我们的技术能直接与NVIDIA架构连接,象征着我们推动全球领先运算技术来促进AI演进的重大里程碑,将打开新一代具扩展性、主权性与可持续发展性的AI系统”。

最后Tom's Hardware也点出值得注意的事,即博通、AMD和英特尔等NVIDIA对手都没有加入NVLink Fusion生态系统,这些公司则与其他企业组成UALink(Ultra Accelerator Link)联盟,目标是打造一个开放标准的产业互联规格,与NVLink抗衡,促进机柜级互联技术的普及与开放使用。

(首图来源:NVIDIA)