Google旗下行动与网页应用程序人工智能开发方案Firebase AI Logic推出新一轮更新,增强多语言支持,并添加即时流媒体回应功能。目前Web平台的流媒体回应功能仍在开发阶段,之后随相关功能上线,Firebase AI Logic将可进一步扩展人工智能应用场景。

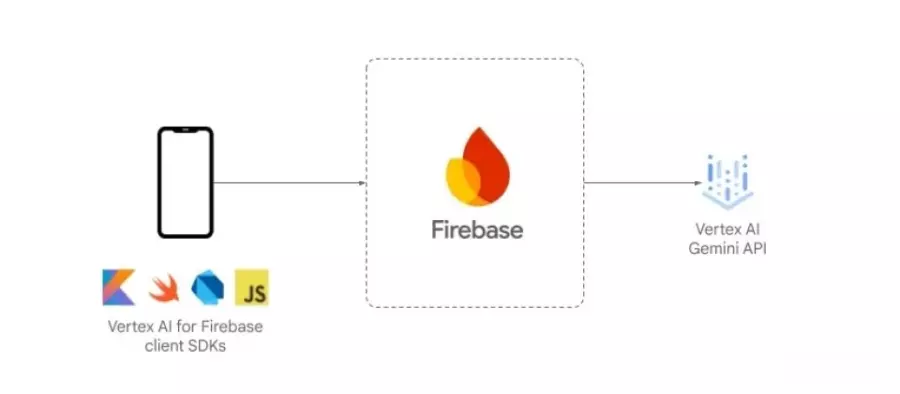

Firebase AI Logic前身为Vertex AI in Firebase,现在正式更名并同步扩展服务范畴。Firebase AI Logic不只是支持Gemini与Imagen等模型,重点更在于行动与网页端可直接通过Swift、Kotlin、Java、Dart、JavaScript及Unity等多平台SDK,安全访问Google生成式人工智能功能,无需自建后端API,有效降低人工智能功能开发与部署门槛。

除了更名,此次更新另一重点在于即时流媒体回应功能。Firebase AI Logic已集成Gemini Live API,让开发者可于App中实现双向流媒体互动,即时获取模型回应结果,提升如聊天机器人、语音助理等互动型应用的用户体验。

根据Google官方说明,目前Gemini Live API仅支持Android、Flutter及Unity平台,并需搭配Vertex AI Gemini API。语音合成部分支持31种语言,有助于拓展人工智能于语音服务及国际市场的应用。流媒体模式同时具备函数调用及结构化数据输出能力,但仅适用于特定平台与API组合。

Firebase AI Logic持续强化App端访问防护,通过Firebase App Check等机制防止API密钥外流与未授权访问,降低滥用风险。系统默认每用户每分钟100次请求的速率限制,并可依企业需求调整。全新Proxy Service设计可避免API密钥存储在应用程序端,进一步满足移动应用的安全需求。

Firebase AI Logic延续与Firebase生态系云计算服务的集成,包括Cloud Storage管理多媒体文件、Cloud Firestore等数据库提供结构化数据支持,以及Remote Config远程调整模型与提示参数,协助开发团队灵活调整人工智能服务内容,无需重新发布App即可进行功能优化或A/B测试。

本次更新也强化多API来源支持,开发者可依需求选用Gemini Developer API或Vertex AI Gemini API,灵活运用Google既有及新推出的人工智能资源。