OpenAI上周先后公布定制化GPTs扩张支持的模型,以及强化ChatGPT搜索功能,现在更能理解用户问题并能以图搜索。

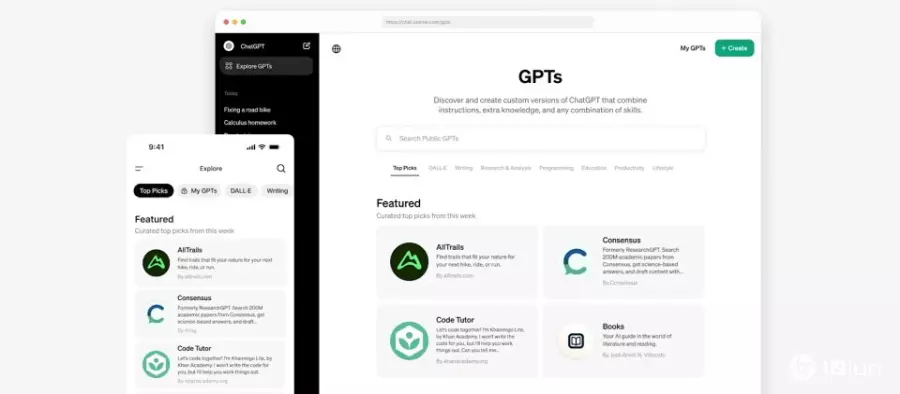

GPTs是允许用户自制符合其领域需求的聊天机器人,去年5月首度开放给所有用户。上周OpenAI开放完整的ChatGPT模型,包括GPT-4o、o3、o4-mini方便开发人员或创作者开发自制GPTs,以便针对不同任务、产业和工作流程微调。开发者们也可设置为其用户推荐的模型。

没有自定义动作(custom action)的GPTs可以从模型菜单中选择所有可用模型。而已有自定义动作的GPTs则支持GPT-4o和GPT 4.1。

目前多种模型支持的功能开放给订阅Pro、Plus、Teams方案的网页版用户,很快会推向Enterprise和Edu方案用户。

除了GPTs,在上周的更新中,OpenAI也改善了ChatGPT搜索品质。相较于去年11月登场、12月公开的版本,新的ChatGPT网页搜索能处理更长的对话上下文,使其在较长对话表现更好,也更能准确理解用户的问题,并且提供更完整的答案。

另一方面,ChatGPT搜索也强化了搜索功能。它能更有效遵循指令,特别是在较长对话中,也大幅减少重复的回答。此外还能根据用户上传的图片搜索网页。更重要的是,ChatGPT现在在复杂或困难问题中将自动执行多次搜索,以提升搜索回应。

不过伴随搜索能力的提升,也引发ChatGPT搜索部分问题。像是ChatGPT回应变得更长,在某些简单查询中,也会出现“思维链”的推理。OpenAI说很快修复这个问题。

OpenAI搜索功能的进步已触发Google改进搜索。Google除了为搜索结果页加入AI Overview,上周进一步测试要把用户搜索结果以Audio Overview技术转换成AI podcast。